Avançando a IA de Código Aberto, NVIDIA Doa Driver de Alocação Dinâmica de Recursos para GPUs à Comunidade Kubernetes

A inteligência artificial emergiu rapidamente como uma das cargas de trabalho mais críticas na computação moderna. Para a grande maioria das empresas, essa carga de trabalho roda no Kubernetes, uma plataforma de código aberto que automatiza a implantação, escalonamento e gerenciamento de aplicações conteinerizadas. Para ajudar a comunidade global de desenvolvedores a gerenciar infraestrutura de IA de alto desempenho com maior transparência e eficiência,

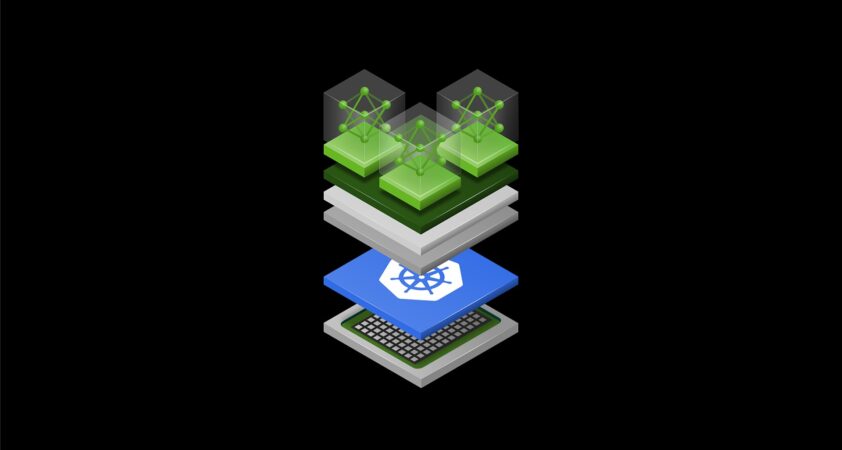

A inteligência artificial emergiu rapidamente como uma das cargas de trabalho mais críticas na computação moderna. Para a grande maioria das empresas, essa carga de trabalho roda no Kubernetes, uma plataforma de código aberto que automatiza a implantação, escalonamento e gerenciamento de aplicações conteinerizadas. Para ajudar a comunidade global de desenvolvedores a gerenciar infraestrutura de IA de alto desempenho com maior transparência e eficiência, a NVIDIA está doando uma peça crítica de software — o Driver de Alocação Dinâmica de Recursos (DRA) NVIDIA para GPUs — para a Cloud Native Computing Foundation (CNCF), uma organização neutra de fornecedores dedicada a fomentar e sustentar o ecossistema cloud-native. Anunciada hoje na KubeCon Europe, a conferência principal da CNCF que ocorre esta semana em Amsterdã, a doação move o driver de uma governança por fornecedor para oferecer propriedade comunitária plena sob o projeto Kubernetes. Este ambiente aberto incentiva um círculo mais amplo de especialistas a contribuir com ideias, acelerar a inovação e ajudar a garantir que a tecnologia permaneça alinhada com o cenário moderno da nuvem. “A profunda colaboração da NVIDIA com a comunidade Kubernetes e CNCF para incorporar o NVIDIA DRA Driver para GPUs marca um marco importante para o Kubernetes de código aberto e a infraestrutura de IA”, disse Chris Aniszczyk, diretor de tecnologia da CNCF. “Ao alinhar suas inovações de hardware com os esforços de conformidade de IA e Kubernetes upstream, a NVIDIA está tornando a orquestração de GPU de alto desempenho contínua e acessível a todos.” Além disso, em colaboração com a comunidade de Contêineres Confidenciais da CNCF, a NVIDIA introduziu suporte para GPU em Kata Containers, máquinas virtuais leves que agem como contêineres. Isso estende a aceleração de hardware para um isolamento mais forte, separando cargas de trabalho para maior segurança e permitindo que cargas de trabalho de IA rodem com proteção aprimorada, para que as organizações possam implementar facilmente a computação confidencial para proteger dados. Simplificando a Infraestrutura de IA Historicamente, o gerenciamento das poderosas GPUs que impulsionam a IA dentro dos data centers exigia um esforço significativo. Esta contribuição foi projetada para tornar a computação de alto desempenho mais acessível. Os principais benefícios para os desenvolvedores incluem: Eficiência Aprimorada: O driver permite o compartilhamento mais inteligente de recursos de GPU, proporcionando o uso efetivo do poder de computação, com suporte às tecnologias NVIDIA Multi-Process Service e NVIDIA Multi-Instance GPU. Escala Massiva: Oferece suporte nativo para conectar sistemas, inclusive com interconexão NVIDIA Multi-Node NVlink.