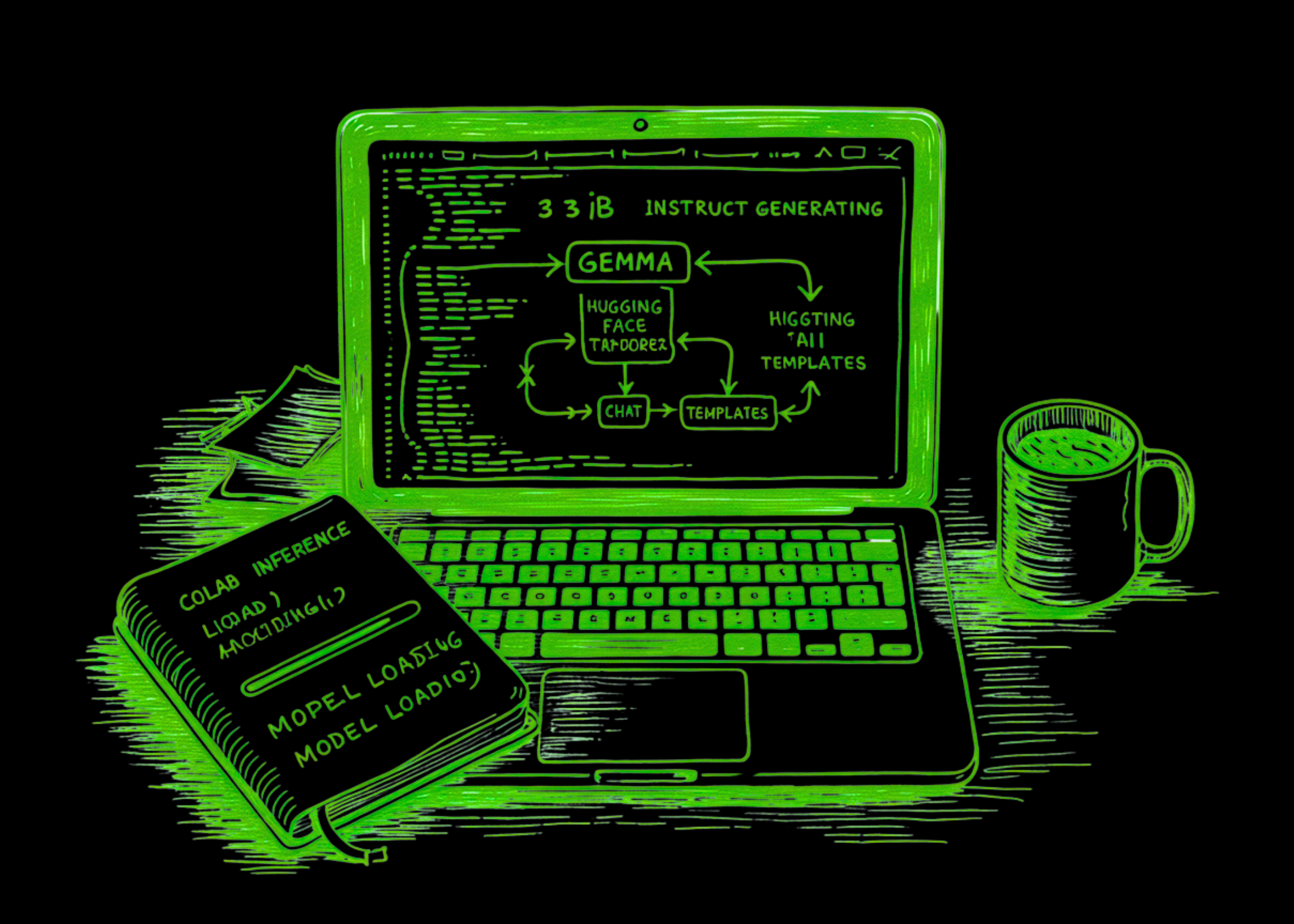

Como construir um pipeline de geração de IA Gemma 3 1B Instruct pronto para produção com Hugging Face Transformers, Chat Templates e inferência Colab

Neste tutorial, construímos e executamos um fluxo de trabalho Colab para o Gemma 3 1B Instruct usando Hugging Face Transformers e HF Token, de forma prática, reprodutível e fácil de seguir, passo a passo. Começamos instalando as bibliotecas necessárias, autenticando-nos de forma segura com nosso token Hugging Face e carregando o tokenizer e o modelo para o dispositivo disponível com […] A postagem Como construir um produto

Neste tutorial, construímos e executamos um fluxo de trabalho Colab para o Gemma 3 1B Instruct usando Hugging Face Transformers e HF Token, de forma prática, reprodutível e fácil de seguir, passo a passo. Começamos instalando as bibliotecas necessárias, autenticando-nos de forma segura com nosso token Hugging Face e carregando o tokenizer e o modelo para o dispositivo disponível com as configurações de precisão corretas. A partir daí, criamos utilitários de geração reutilizáveis, formatamos prompts em uma estrutura estilo chat e testamos o modelo em várias tarefas realistas, como geração básica, respostas estruturadas no estilo JSON, encadeamento de prompts, benchmarking e sumarização determinística, para que não apenas carreguemos o Gemma, mas realmente trabalhemos com ele de forma significativa. Copiar Código Copiado Usar um navegador diferente import os import sys import time import json import getpass import subprocess import warnings warnings.filterwarnings("ignore") def pip_install(*pkgs): subprocess.check_call([sys.executable, "-m", "pip", "install", "-q", *pkgs]) pip_install( "transformers>=4.51.0", "accelerate", "sentencepiece", "safetensors", "pandas", ) import torch import pandas as pd from huggingface_hub import login from transformers import AutoTokenizer, AutoModelForCausalLM print("=" * 100) print("PASSO 1 — Autenticação Hugging Face") print("=" * 100) hf_token = None try: from google.colab import userdata try: hf_token = userdata.get("HF_TOKEN") except Exception: hf_token = None except Exception: pass if not hf_token: hf_token = getpass.getpass("Digite seu token Hugging Face: ").strip() login(token=hf_token) os.environ["HF_TOKEN"] = hf_token print("Login HF bem-sucedido.") Configuramos o ambiente necessário para executar o tutorial sem problemas no Google Colab. Instalamos as bibliotecas necessárias, importamos todas as dependências principais e autenticamos-nos de forma segura com o Hugging Face usando nosso token. Ao final desta parte, prepararemos o notebook para acessar o modelo Gemma e continuar o fluxo de trabalho sem problemas de configuração manual. Copiar Código Copiado Usar um navegador diferente print("=" * 100) print("PASSO 2 — Configuração do dispositivo") print("=" * 100) device = "cuda" if torch.cuda.is_available() else "cpu" dtype = torch.bfloat16 if torch.cuda.is_available() else torch.float32 print("device:", device) print("dtype:", dtype) model_id = "google/gemma-3-1b-it" print("model_id:", model_id) print("=" * 100) print("PASSO 3 — Carregar tokenizer e modelo") print("=" * 100) tokenizer = AutoTokenizer.from_pretrained(