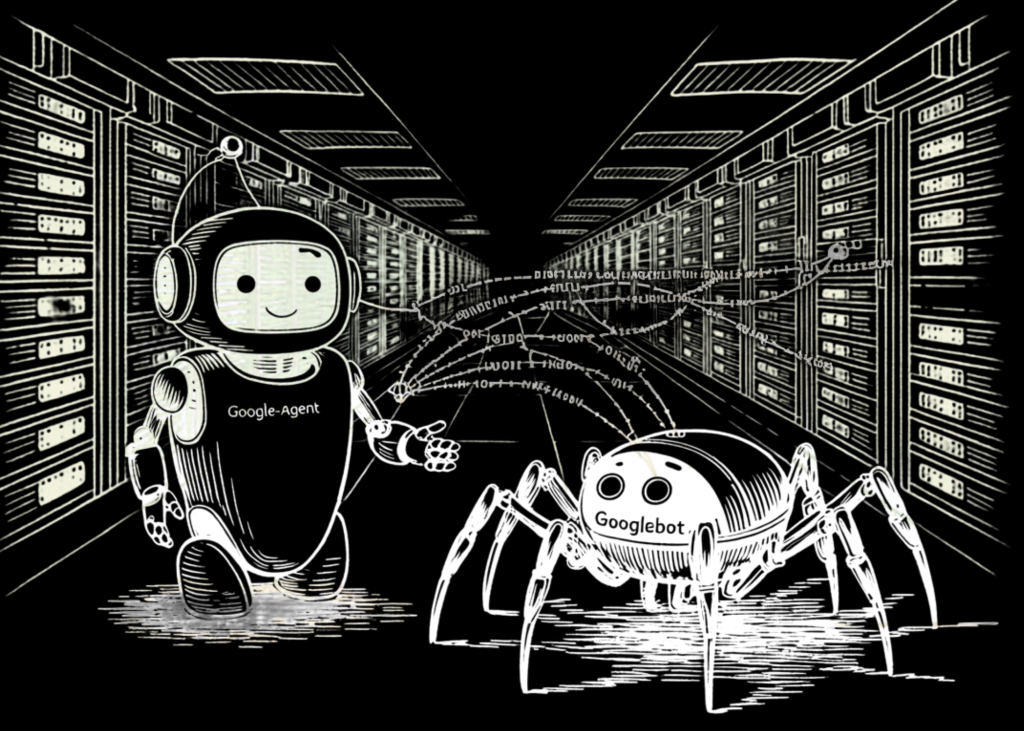

Google-Agent vs Googlebot: Google Define a Fronteira Técnica Entre o Acesso de IA Acionado por Usuário e os Sistemas de Rastreamento de Busca Hoje

À medida que o Google integra capacidades de IA em seu conjunto de produtos, uma nova entidade técnica surgiu nos logs do servidor: Google-Agent. Para desenvolvedores de software, entender essa entidade é crucial para distinguir entre indexadores automatizados e solicitações em tempo real, iniciadas pelo usuário. Diferente dos crawlers autônomos que definiram a web por décadas, o Google-Agent opera sob um conjunto diferente de regras [& #82

À medida que o Google integra capacidades de IA em seu conjunto de produtos, uma nova entidade técnica surgiu nos logs do servidor: Google-Agent. Para desenvolvedores de software, entender essa entidade é crucial para distinguir entre indexadores automatizados e solicitações em tempo real, iniciadas pelo usuário. Diferente dos crawlers autônomos que definiram a web por décadas, o Google-Agent opera sob um conjunto diferente de regras e protocolos. A Distinção Central: Fetchers vs. Crawlers A diferença técnica fundamental entre os bots legados do Google e o Google-Agent reside no mecanismo de acionamento. Crawlers Autônomos (por exemplo, Googlebot): Estes descobrem e indexam páginas em um cronograma determinado pelos algoritmos do Google para manter o índice de Busca. Fetchers Acionados por Usuário (por exemplo, Google-Agent): Essas ferramentas só agem quando um usuário realiza uma ação específica. De acordo com a documentação do desenvolvedor do Google, o Google-Agent é utilizado pelos produtos de IA do Google para buscar conteúdo da web em resposta a um comando direto do usuário. Como esses fetchers são reativos em vez de proativos, eles não 'rastreiam' a web seguindo links para descobrir novos conteúdos. Em vez disso, eles agem como um proxy para o usuário, recuperando URLs específicas conforme solicitado. A Exceção Robots.txt Uma das nuances técnicas mais significativas do Google-Agent é sua relação com o robots.txt. Enquanto crawlers autônomos como o Googlebot aderem estritamente às diretivas do robots.txt para determinar quais partes de um site devem ser indexadas, os fetchers acionados por usuário geralmente operam sob um protocolo diferente. A documentação do Google afirma explicitamente que os fetchers acionados por usuário ignoram o robots.txt. A lógica por trás dessa “derivação” está enraizada na natureza de 'proxy' do agente. Como a busca é iniciada por um usuário humano solicitando interagir com um conteúdo específico, o fetcher se comporta mais como um navegador web padrão do que um crawler de busca. Se um proprietário de site bloquear o Google-Agent via robots.txt, a instrução será normalmente ignorada porque a solicitação é vista como uma ação manual em nome do usuário, em vez de um esforço de coleta em massa automatizado. Identificação e Strings de User-Agent Os desenvolvedores devem ser capazes de identificar com precisão esse tráfego para evitar que seja sinalizado como scraping malicioso ou não autorizado. O Google-Agent se identifica por meio de strings de User-Agent específicas. A string primária para este fetcher é: Mozilla/5.0 (Linux; Android 6.0.1; Nexus 5X Build/MMB29P) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/W.X.Y.Z Mobile Safa